Super916

用户暂无简介

Super916

去朋友家小坐了一会,被他家养了五年的 “小胖子” 狠狠圈粉了!这猫圆滚滚的我估计得有十来斤,rua 起来软乎乎的,手感绝了哈哈哈

不过我还是想问,这是姿势,也太妖娆了吧,忍不住笑问朋友 “你家猫这是解锁了什么新姿势呀”!

陪它玩了好一会儿,小家伙玩累了就乖乖趴在旁边守着,我也顺势靠在沙发上刷我的手机了,这种慢悠悠的惬意时光也太舒服了吧!

然后刷到不少老师在分享 @flipster_io ,也去好奇的看了下,把猫丢一边了,发现这项目好像还可以,值得做一下

它们是主打永续合约交易,体验顺、对新老用户还挺友好的,刚好还赶上它办新年交易大赛,奖池最高 35 万 U,主要是被这个吸引了,但是我好像来晚了,错过了!!!

不过问题不大 ,Flipster @flipster_io活动很频繁,下一个可能很快就有了哈哈

当然,大赛只是加分项,其实更看重平台本身的硬实力 —— 毕竟撸完奖励能不能长期用,才是关键。

它 2021 年就成立了,现在百万用户、月交易量破 200 亿美元,起码排除小项目的标签了,而且还有个 “边交易边生息” 的功能,保证金不用闲置,这点还是安利到我了

等我再去仔细研究一下,后面在慢慢拆解它的交易体验、新手友好度、生息功能这些核心亮点,想一起了解的朋友可以蹲一手玩玩!

#Flipster #新项目分享 #交易大赛

不过我还是想问,这是姿势,也太妖娆了吧,忍不住笑问朋友 “你家猫这是解锁了什么新姿势呀”!

陪它玩了好一会儿,小家伙玩累了就乖乖趴在旁边守着,我也顺势靠在沙发上刷我的手机了,这种慢悠悠的惬意时光也太舒服了吧!

然后刷到不少老师在分享 @flipster_io ,也去好奇的看了下,把猫丢一边了,发现这项目好像还可以,值得做一下

它们是主打永续合约交易,体验顺、对新老用户还挺友好的,刚好还赶上它办新年交易大赛,奖池最高 35 万 U,主要是被这个吸引了,但是我好像来晚了,错过了!!!

不过问题不大 ,Flipster @flipster_io活动很频繁,下一个可能很快就有了哈哈

当然,大赛只是加分项,其实更看重平台本身的硬实力 —— 毕竟撸完奖励能不能长期用,才是关键。

它 2021 年就成立了,现在百万用户、月交易量破 200 亿美元,起码排除小项目的标签了,而且还有个 “边交易边生息” 的功能,保证金不用闲置,这点还是安利到我了

等我再去仔细研究一下,后面在慢慢拆解它的交易体验、新手友好度、生息功能这些核心亮点,想一起了解的朋友可以蹲一手玩玩!

#Flipster #新项目分享 #交易大赛

- 赞赏

- 点赞

- 评论

- 转发

- 分享

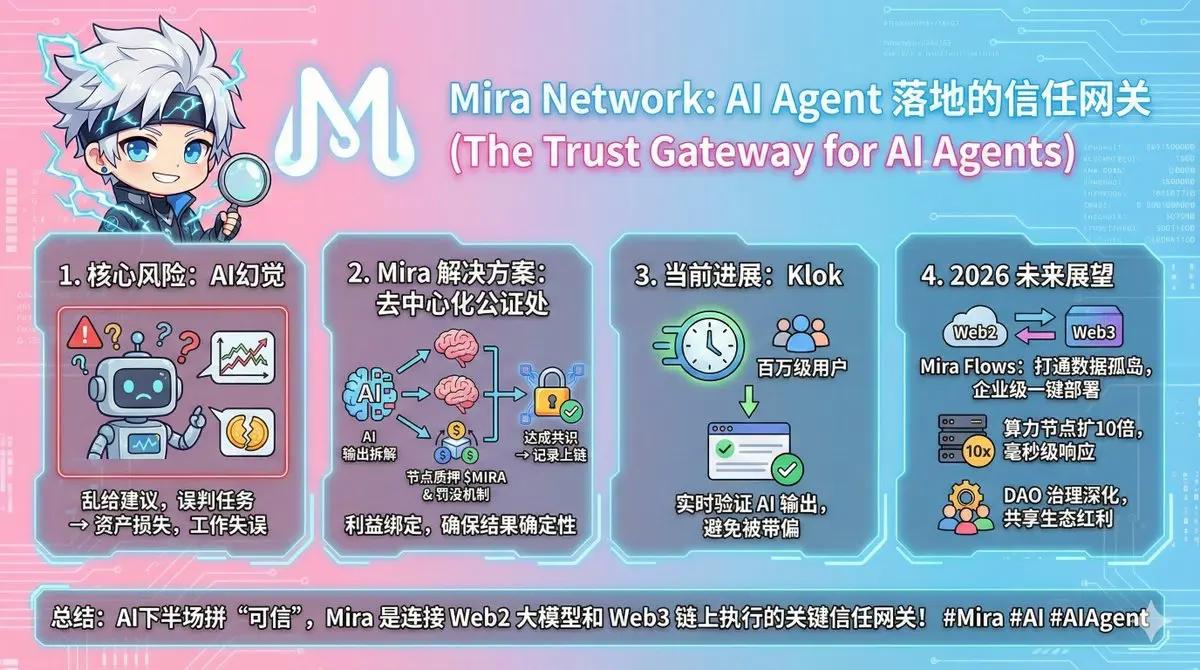

前两天和朋友打语音聊到 AI Agent 落地,都在说它能帮着处理链上交易、代做工作任务,却很少有人提最核心的风险

这智能代理要是犯 “幻觉”,乱给交易建议或误判任务,造成的损失谁来扛?毕竟涉及资产和实际工作,光聪明没用,毕竟靠谱才是底线

然后我就给朋友说,你是不是忽略了一个项目,米粒@miranetwork刚好就是解决这个问题的,它不做更牛的 AI 模型了,而是定位成 AI 的 “去中心化公证处”

和其他验证项目不同,它走的是模型整合的路子:把 AI 输出拆解成一个个可验证的点,丢给多个不同大模型和节点交叉验证,只有达成共识的结果,才会被记录上链

为了让验证靠谱,节点还得质押 $MIRA 才能参与,要是判断出错或者作恶,质押的代币就会被罚没,这种利益绑定的方式,才让验证结果有了真正确定性。

它也不是只停留在叙事阶段,已经上线的 Klok 吸引了百万级用户,能实时验证 AI 输出,避免大家被看似合理的错误回答带偏

2026 年的方向也很清晰,从基建搭建转向生态爆发:Mira Flows 要打通 Web2 和 Web3 的数据孤岛,让企业级 AI 应用一键部署;

算力节点规模预计扩 10 倍,实现毫秒级响应;DAO 治理也会深化,让开发者和节点贡献者共享生态红利

现在 AI 上半场拼参数,下半场拼的是 “谁更可信”,Mira 刚好踩中这个生态位

它就像 Web2 大模型和 Web3

这智能代理要是犯 “幻觉”,乱给交易建议或误判任务,造成的损失谁来扛?毕竟涉及资产和实际工作,光聪明没用,毕竟靠谱才是底线

然后我就给朋友说,你是不是忽略了一个项目,米粒@miranetwork刚好就是解决这个问题的,它不做更牛的 AI 模型了,而是定位成 AI 的 “去中心化公证处”

和其他验证项目不同,它走的是模型整合的路子:把 AI 输出拆解成一个个可验证的点,丢给多个不同大模型和节点交叉验证,只有达成共识的结果,才会被记录上链

为了让验证靠谱,节点还得质押 $MIRA 才能参与,要是判断出错或者作恶,质押的代币就会被罚没,这种利益绑定的方式,才让验证结果有了真正确定性。

它也不是只停留在叙事阶段,已经上线的 Klok 吸引了百万级用户,能实时验证 AI 输出,避免大家被看似合理的错误回答带偏

2026 年的方向也很清晰,从基建搭建转向生态爆发:Mira Flows 要打通 Web2 和 Web3 的数据孤岛,让企业级 AI 应用一键部署;

算力节点规模预计扩 10 倍,实现毫秒级响应;DAO 治理也会深化,让开发者和节点贡献者共享生态红利

现在 AI 上半场拼参数,下半场拼的是 “谁更可信”,Mira 刚好踩中这个生态位

它就像 Web2 大模型和 Web3

- 赞赏

- 点赞

- 评论

- 转发

- 分享

这个菜相信大家都认识吧,也是我最爱吃的菜之一了,白灼生菜!

一段时间没看,家门口的菜竟然长的这么快,看着太养眼了,晚上烫火锅又有得吃了,不知道为什么每次吃自己家种的菜总感觉要更香一点🤣

然后这段时间也是发现自己对AI也是比较依赖了,不管找信息还是找图片,都是用的它,这些我倒是不担心,但是用 AI 做交易参考,还是让它出点工作方案,就觉得心里没底了

不是说它做得不好,主要是根本不知道它是怎么得出结论的,全程就是个迷!一无所知!

万一出了错就凉了?比如给交易建议错了亏了钱,或者医疗相关的建议出了些问题,到时候找谁说理去?

说是模型的问题,还是运行的节点有问题?尤其像金融、医疗这种地方,真出事了,一句 “AI 当时就这么判断的” 根本没用,人家要的是能说清、能查到源头的凭证。

我也是后来发现朋友都在关注的@inference_labs 就是专门解决这个坑的,所以也觉得开始认真关注一下了

这项目简单看了下,没跟着乱跑, “大模型、高参数” 的热闹,反而盯着最核心的问题:怎么让 AI 每一次给结论,都能让人看清来路、能核对,真出问题了还能找到该担责的环节

这事看着不花哨,甚至有点 “傻傻的”,但对咱普通人来说,恰恰是最让人放心的地方 —— 下次再来和大家说说,它具体是怎么操作解决这些问题的!

#InferenceLabs #AI #可验证AI #Web3

一段时间没看,家门口的菜竟然长的这么快,看着太养眼了,晚上烫火锅又有得吃了,不知道为什么每次吃自己家种的菜总感觉要更香一点🤣

然后这段时间也是发现自己对AI也是比较依赖了,不管找信息还是找图片,都是用的它,这些我倒是不担心,但是用 AI 做交易参考,还是让它出点工作方案,就觉得心里没底了

不是说它做得不好,主要是根本不知道它是怎么得出结论的,全程就是个迷!一无所知!

万一出了错就凉了?比如给交易建议错了亏了钱,或者医疗相关的建议出了些问题,到时候找谁说理去?

说是模型的问题,还是运行的节点有问题?尤其像金融、医疗这种地方,真出事了,一句 “AI 当时就这么判断的” 根本没用,人家要的是能说清、能查到源头的凭证。

我也是后来发现朋友都在关注的@inference_labs 就是专门解决这个坑的,所以也觉得开始认真关注一下了

这项目简单看了下,没跟着乱跑, “大模型、高参数” 的热闹,反而盯着最核心的问题:怎么让 AI 每一次给结论,都能让人看清来路、能核对,真出问题了还能找到该担责的环节

这事看着不花哨,甚至有点 “傻傻的”,但对咱普通人来说,恰恰是最让人放心的地方 —— 下次再来和大家说说,它具体是怎么操作解决这些问题的!

#InferenceLabs #AI #可验证AI #Web3

- 赞赏

- 点赞

- 评论

- 转发

- 分享

MemeMax @MemeMax_Fi 的参与方式基本给大家都说清楚了,那肯定也不能忽略它的代币 $M 了,表现确实让人放心

市场行情波动这么大,它跌下去一段时间总能拉回来,成交也越来越密集,完全没跟着乱飘

这背后的原因我觉得很简单,一个是 MemeCore 给了 3 亿 $M 生态基金,而且主要用来做链上激励,不是直接抛售,从根源上减少了抛压,这也是小项目很难做到的。

其次是回购机制很实在,Pre-Launch 阶段所有交易手续费,都会 100% 用来回购 $M 并销毁。简单说就是参与交易的人越多,手续费越多,回购力度就越大,形成了正向循环

还有一点很关键,团队从年初运营到现在,一直持续砸营销,二级市场也有稳定动作,不是那种捞一笔就跑的短期项目,这种稳扎稳打的节奏,让 $M 的价值有了长期支撑

今天就说到这啦,下一篇我换个角度和大家聊聊,看看 MemeMax 和普通 Perp DEX 到底不一样在哪,为什么说它是 “Meme 文化的金融化引擎”

#MemeMax #M #Web3基本面

市场行情波动这么大,它跌下去一段时间总能拉回来,成交也越来越密集,完全没跟着乱飘

这背后的原因我觉得很简单,一个是 MemeCore 给了 3 亿 $M 生态基金,而且主要用来做链上激励,不是直接抛售,从根源上减少了抛压,这也是小项目很难做到的。

其次是回购机制很实在,Pre-Launch 阶段所有交易手续费,都会 100% 用来回购 $M 并销毁。简单说就是参与交易的人越多,手续费越多,回购力度就越大,形成了正向循环

还有一点很关键,团队从年初运营到现在,一直持续砸营销,二级市场也有稳定动作,不是那种捞一笔就跑的短期项目,这种稳扎稳打的节奏,让 $M 的价值有了长期支撑

今天就说到这啦,下一篇我换个角度和大家聊聊,看看 MemeMax 和普通 Perp DEX 到底不一样在哪,为什么说它是 “Meme 文化的金融化引擎”

#MemeMax #M #Web3基本面

M2.38%

- 赞赏

- 点赞

- 评论

- 转发

- 分享

祝大家新年快乐!2025已经完美落幕啦,让我们一起迎接更好的2026!

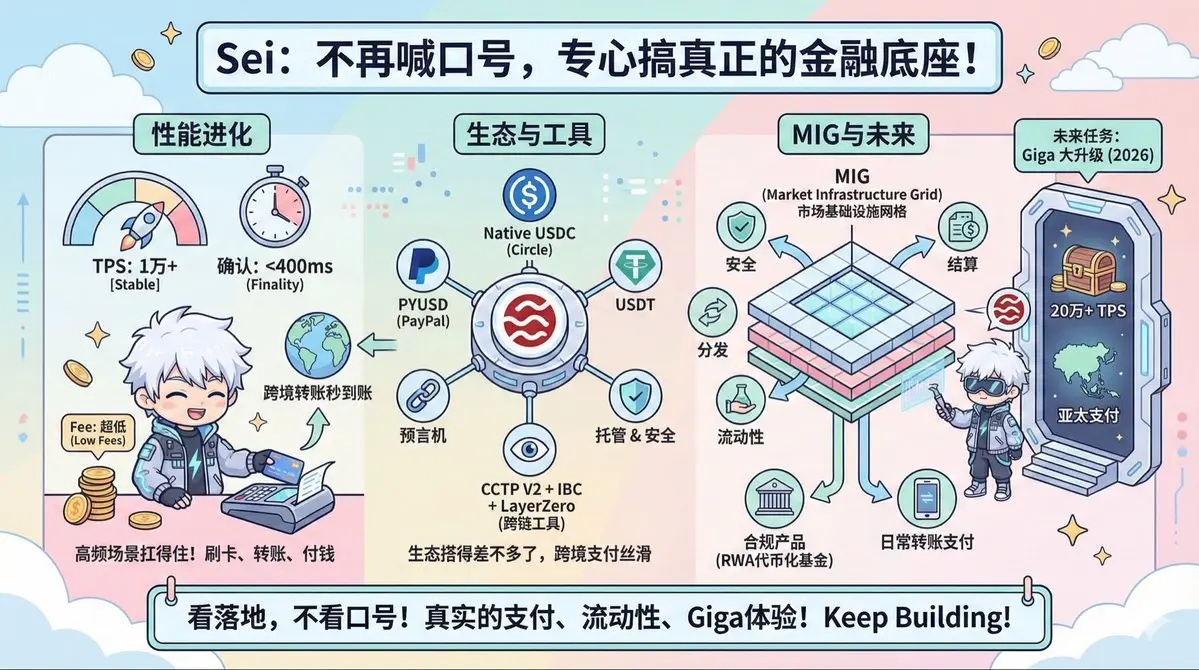

不知道大家最近发现没,Sei @SeiNetwork现在也不喊什么“全世界最快的L1”了,因为这些在实现的路上了,现在反而一直在专心搞真正能服务现代金融的底座

这变化受益比较多的就是我们这些普通用户了,先说性能吧:

现在主网已经能稳定跑到1万多TPS,交易确认基本400毫秒以内搞定(比很多链快太多了)

这意味着刷卡、转账、付钱这种高频场景完全扛得住

手续费低到几乎忽略不计,跨境转个USDC基本秒到账,不用像以前等半天,生态也搭得差不多了

原生支持USDC(Circle直接集成)、PayPal的PYUSD、USDT等主流稳定币

CCTP V2 + IBC + LayerZero这些跨链工具用着顺手

预言机、托管、机构级安全设施都到位

简单讲:就是想跨境付钱?不用等、不贵、流程丝滑

12月中下旬重磅推出的叫“Market Infrastructure Grid”(市场基础设施网格,简称MIG),把安全、结算、分发、流动性这些环节全打通了

机构发的合规产品(比如RWA代币化基金)、咱们日常转账支付,都能在这套系统里高效跑起来了

选择变多,安全性也更高,接下来几个月,Sei重点会推支付场景落地,同时为Giga大升级做热身,Giga在测试网已经跑到20万TPS,主网上线后(预计2026年初)性能还会再飞一级

团队还打算深

不知道大家最近发现没,Sei @SeiNetwork现在也不喊什么“全世界最快的L1”了,因为这些在实现的路上了,现在反而一直在专心搞真正能服务现代金融的底座

这变化受益比较多的就是我们这些普通用户了,先说性能吧:

现在主网已经能稳定跑到1万多TPS,交易确认基本400毫秒以内搞定(比很多链快太多了)

这意味着刷卡、转账、付钱这种高频场景完全扛得住

手续费低到几乎忽略不计,跨境转个USDC基本秒到账,不用像以前等半天,生态也搭得差不多了

原生支持USDC(Circle直接集成)、PayPal的PYUSD、USDT等主流稳定币

CCTP V2 + IBC + LayerZero这些跨链工具用着顺手

预言机、托管、机构级安全设施都到位

简单讲:就是想跨境付钱?不用等、不贵、流程丝滑

12月中下旬重磅推出的叫“Market Infrastructure Grid”(市场基础设施网格,简称MIG),把安全、结算、分发、流动性这些环节全打通了

机构发的合规产品(比如RWA代币化基金)、咱们日常转账支付,都能在这套系统里高效跑起来了

选择变多,安全性也更高,接下来几个月,Sei重点会推支付场景落地,同时为Giga大升级做热身,Giga在测试网已经跑到20万TPS,主网上线后(预计2026年初)性能还会再飞一级

团队还打算深

- 赞赏

- 4

- 评论

- 转发

- 分享

家人们,这对吗,你们在外面跨年,我在家里疯狂看奥特曼,看了好几天了连续,停不下来🤣,已经把战力前五的排名都背下来了!

感觉不能继续看了,太容易上瘾了,我还是看看web3吧!

看了下Messari 数据和链上表现显示,Sui 生态正从规模扩张转向成熟运营,TVL 突破 20 亿美元,日活与交易量持续放量,表现还是不错的

这个阶段,单纯复制的项目难有空间,市场更需要能提升资金效率的基础设施了

前两天给大家介绍的@ferra_protocol 恰好卡位这个需求,它定位为动态流动性层

不同于让资金静静躺在池子里吃利息,它通过算法调度,把流动性送到链上最需要的地方

这种设计虽然在生态早期不显眼,但随着 Sui 上资产增多、交易策略复杂,解决滑点、提升 DeFi 深度的中间件会成为刚需的

Ferra 也不只是普通 DEX,是 Sui 生态精细化运作的关键一环,看好 Sui 后续爆发的话,这类卡位精准的基础设施千里还是很大的

还有一个比较舒服的就是 Ferra 的代币激励规则,清晰务实且无模糊没有套路

项目拿出总量 0.25% 的代币用于早期激励,TGE 阶段直接发放、无锁仓,不拆分周期、不拉长兑现,其中 0.20% 给到内容创作者,覆盖全球前 400 名及中日韩区域前 300 名,剩余 0.05% 定向分配给 Kaito @KaitoAI生态

这种直接的兑现方式,让早期参与者的风险与收益对等

感觉不能继续看了,太容易上瘾了,我还是看看web3吧!

看了下Messari 数据和链上表现显示,Sui 生态正从规模扩张转向成熟运营,TVL 突破 20 亿美元,日活与交易量持续放量,表现还是不错的

这个阶段,单纯复制的项目难有空间,市场更需要能提升资金效率的基础设施了

前两天给大家介绍的@ferra_protocol 恰好卡位这个需求,它定位为动态流动性层

不同于让资金静静躺在池子里吃利息,它通过算法调度,把流动性送到链上最需要的地方

这种设计虽然在生态早期不显眼,但随着 Sui 上资产增多、交易策略复杂,解决滑点、提升 DeFi 深度的中间件会成为刚需的

Ferra 也不只是普通 DEX,是 Sui 生态精细化运作的关键一环,看好 Sui 后续爆发的话,这类卡位精准的基础设施千里还是很大的

还有一个比较舒服的就是 Ferra 的代币激励规则,清晰务实且无模糊没有套路

项目拿出总量 0.25% 的代币用于早期激励,TGE 阶段直接发放、无锁仓,不拆分周期、不拉长兑现,其中 0.20% 给到内容创作者,覆盖全球前 400 名及中日韩区域前 300 名,剩余 0.05% 定向分配给 Kaito @KaitoAI生态

这种直接的兑现方式,让早期参与者的风险与收益对等

- 赞赏

- 1

- 评论

- 转发

- 分享

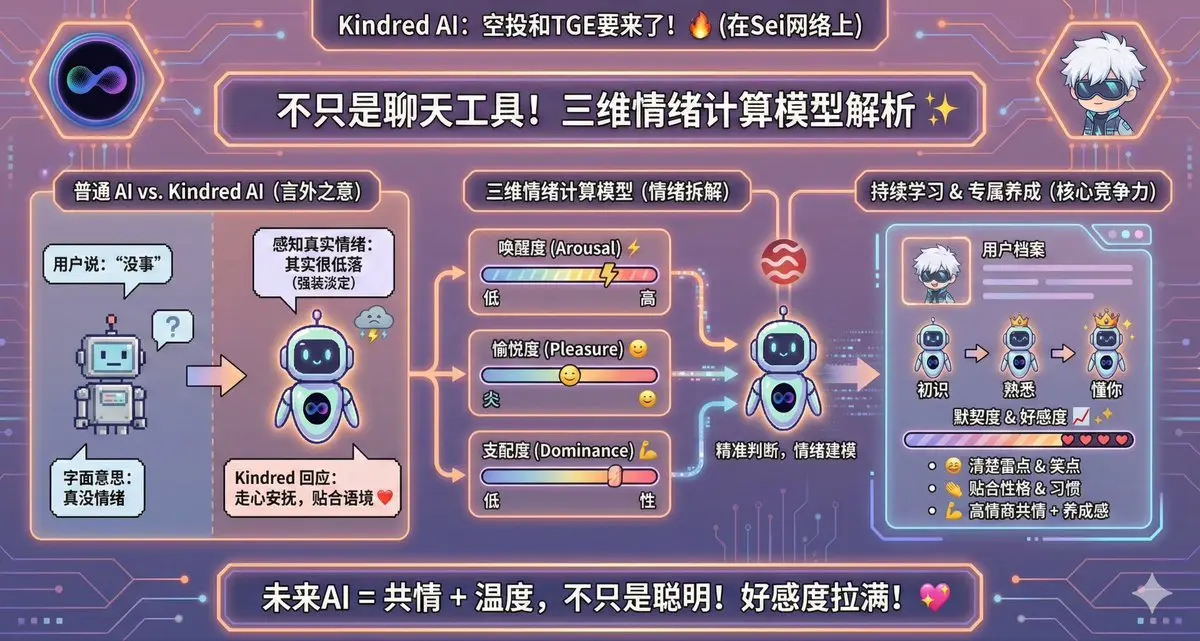

这两天相信大家都看到@Kindred_AI发推暗示了吧,这大概率是空投和TGE要来了,重点关注一下吧!

毕竟是sei 上面热度最高的项目之一了,再加上Sei @SeiNetwork最近表现也不错!

还有就是看很多朋友在说,Kindred 不就是个对接了 API 的聊天工具吗?

其实真不是这么回事的,如果只是简单套壳主流大模型,根本不可能在扎堆的 AI 赛道里站稳脚跟

Kindred 真正比较厉害的地方,是它打磨出的一套三维情绪计算模型。把情绪拆解成唤醒度、愉悦度、支配度三个维度,说简单点就是:

普通 AI 只能看懂你说的字面意思,而 Kindred 能读懂你的言外之意,能感知你的真实情绪状态

你平平淡淡地说一句 “没事”,普通 AI 只会当真觉得你没情绪,但 Kindred 会结合你的聊天语境、表达频率,判断出你的情绪状态其实很低落

能察觉到你是在强装淡定、嘴上说着没事心里有事,然后给到贴合的、走心的安抚回应,而不是生硬的套话

而且它还有持续学习的能力,你和它聊得越久,它就越懂你,清楚你的雷点在哪、笑点是什么,会慢慢贴合你的性格和情绪习惯

这种高情商的共情 + 专属的养成感,才是它能留住用户的核心,也是最不一样的地方

当下做 AI 的太多了,大家都在拼智能、拼功能,但其实未来的 AI 赛道,拼的从来不是谁更 “聪明”,而是谁能更懂人,能贴近人心的温度,这样后面的好感度肯定给大家拉满

毕竟是sei 上面热度最高的项目之一了,再加上Sei @SeiNetwork最近表现也不错!

还有就是看很多朋友在说,Kindred 不就是个对接了 API 的聊天工具吗?

其实真不是这么回事的,如果只是简单套壳主流大模型,根本不可能在扎堆的 AI 赛道里站稳脚跟

Kindred 真正比较厉害的地方,是它打磨出的一套三维情绪计算模型。把情绪拆解成唤醒度、愉悦度、支配度三个维度,说简单点就是:

普通 AI 只能看懂你说的字面意思,而 Kindred 能读懂你的言外之意,能感知你的真实情绪状态

你平平淡淡地说一句 “没事”,普通 AI 只会当真觉得你没情绪,但 Kindred 会结合你的聊天语境、表达频率,判断出你的情绪状态其实很低落

能察觉到你是在强装淡定、嘴上说着没事心里有事,然后给到贴合的、走心的安抚回应,而不是生硬的套话

而且它还有持续学习的能力,你和它聊得越久,它就越懂你,清楚你的雷点在哪、笑点是什么,会慢慢贴合你的性格和情绪习惯

这种高情商的共情 + 专属的养成感,才是它能留住用户的核心,也是最不一样的地方

当下做 AI 的太多了,大家都在拼智能、拼功能,但其实未来的 AI 赛道,拼的从来不是谁更 “聪明”,而是谁能更懂人,能贴近人心的温度,这样后面的好感度肯定给大家拉满

SEI4.44%

- 赞赏

- 点赞

- 1

- 转发

- 分享

wifaqgsm :

:

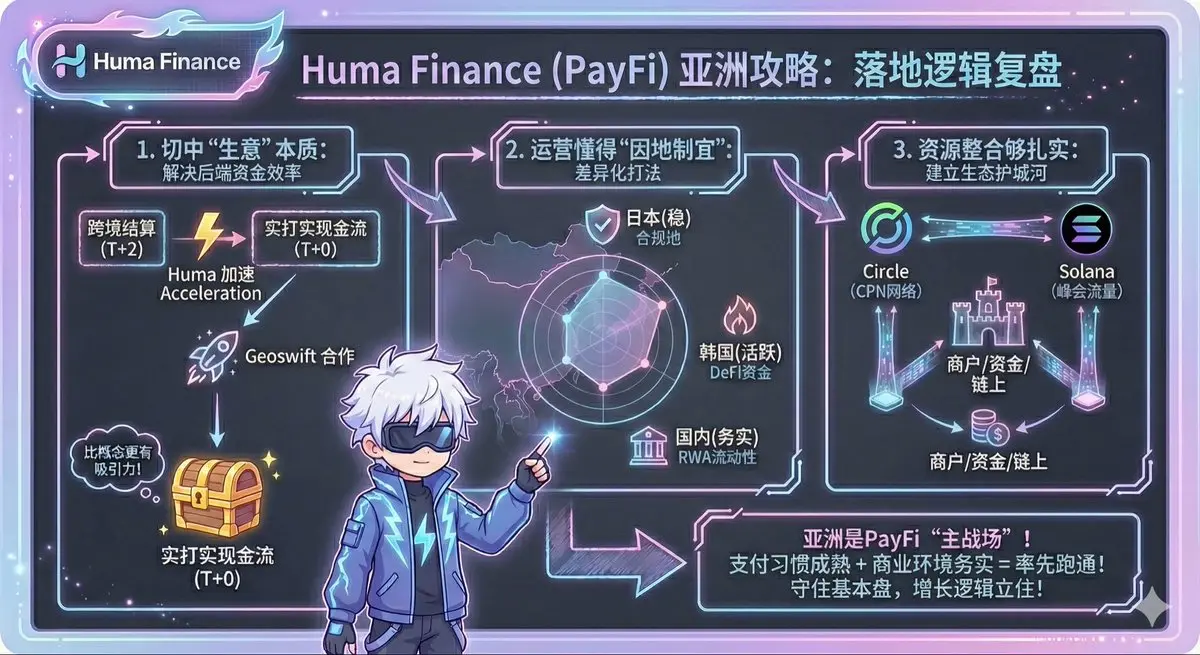

我们太过关注这块币了,它永远不会涨。没事去复盘了一下 Huma @humafinance 的亚洲巡回数据,新加坡和上海的线下热度确实超出了预期

作为一个 ToB 属性较重的项目,能有这种关注度,说明 PayFi 在亚洲确实有真实的土壤所在的

Huma 这步棋走得明白,核心就赢在三点:

1. 切中“生意”的本质

亚洲移动支付基建成熟,但跨境结算依然有难题,Huma 没去卷前端体验,而是专注解决后端的资金效率。

比如与 Geoswift 合作,帮跨境商户把回款周期从 T+2 压缩到 T+0,对商户而言,这就是实打实的现金流,比任何高大上的概念都具吸引力。

2. 运营懂得“因地制宜”

他们没有试图用一套方案通吃,而是针对不同市场调整策略:

日本资金求稳,重点推合规池(数据显示日区用户占比很高)

韩国市场活跃,多在 KBW 等场合曝光,吸纳DeFi资金

国内看重务实,少谈颠覆,多讲 RWA 如何具体解决企业的流动性难题

3. 资源整合够扎实

在亚洲市场,资源厚度决定落地速度,Huma 一边接入 Circle 的 CPN 网络降低借贷门槛,一边联手 Solana 办峰会共享生态流量,这种打法有效串联了商户、资金端和链上生态,护城河建得很稳

我是觉得将亚洲作为“主战场”是明智之举,这里的支付习惯最成熟,商业环境也最务实。

PayFi 这种将 Web3 金融融入现实生意的模式,大概率会率先在亚洲跑通,Huma 只要守住这里的

作为一个 ToB 属性较重的项目,能有这种关注度,说明 PayFi 在亚洲确实有真实的土壤所在的

Huma 这步棋走得明白,核心就赢在三点:

1. 切中“生意”的本质

亚洲移动支付基建成熟,但跨境结算依然有难题,Huma 没去卷前端体验,而是专注解决后端的资金效率。

比如与 Geoswift 合作,帮跨境商户把回款周期从 T+2 压缩到 T+0,对商户而言,这就是实打实的现金流,比任何高大上的概念都具吸引力。

2. 运营懂得“因地制宜”

他们没有试图用一套方案通吃,而是针对不同市场调整策略:

日本资金求稳,重点推合规池(数据显示日区用户占比很高)

韩国市场活跃,多在 KBW 等场合曝光,吸纳DeFi资金

国内看重务实,少谈颠覆,多讲 RWA 如何具体解决企业的流动性难题

3. 资源整合够扎实

在亚洲市场,资源厚度决定落地速度,Huma 一边接入 Circle 的 CPN 网络降低借贷门槛,一边联手 Solana 办峰会共享生态流量,这种打法有效串联了商户、资金端和链上生态,护城河建得很稳

我是觉得将亚洲作为“主战场”是明智之举,这里的支付习惯最成熟,商业环境也最务实。

PayFi 这种将 Web3 金融融入现实生意的模式,大概率会率先在亚洲跑通,Huma 只要守住这里的

- 赞赏

- 点赞

- 评论

- 转发

- 分享

好家伙,Sui @SuiNetwork生态上面又有项目可以玩了,估计大家都看到苗头了吧,就是这个发现 Ferra @ferra_protocol

简单看了下,好像还行,不是那种爱吹牛吸引人的普通 DEX,是实打实有在Sui 做流动性底层的

它整合了好几种做市模式,专门解决 Sui 生态里流动性浅、滑点高的问题 —— 让资金不再是死躺在池子里,而是能跟着市场情况调整仓位

这样 LP 既能减少亏损,资金用起来也更高效,不管是做 LP、交易还是开发的人,需求都能兼顾到

和那些靠短期高补贴堆数据的项目不一样,Ferra 更愿意先把底层结构打磨好,这种不搞虚的节奏,在现在的市场里反而更有好感

我比较感兴趣的是它最近上的 Private TG 群,这操作挺反常规的 —— 不敞开招人,反而设了门槛。大家应该都有体会,现在很多项目群一打开全是水军喊单,除了情绪没半点有用的信息

Ferra 这个群就是要把这些噪音筛掉,只收真正为生态做贡献的人,比如有 Jacuzzi Badge 的、搞 Guild 的、链上交易活跃的大佬,还有 Kaito @KaitoAI上写优质内容的创作者。

进这个群的价值还是有的:能提前拿到产品更新信息、有专属福利,还能直接对接团队获得支持,不用在万人大群里费劲爬楼找信号,能通过审批进去,就说明你被项目方当成 “核心用户”了,后续有什么权益分配,大概率会更偏向这类人。

如果是在

简单看了下,好像还行,不是那种爱吹牛吸引人的普通 DEX,是实打实有在Sui 做流动性底层的

它整合了好几种做市模式,专门解决 Sui 生态里流动性浅、滑点高的问题 —— 让资金不再是死躺在池子里,而是能跟着市场情况调整仓位

这样 LP 既能减少亏损,资金用起来也更高效,不管是做 LP、交易还是开发的人,需求都能兼顾到

和那些靠短期高补贴堆数据的项目不一样,Ferra 更愿意先把底层结构打磨好,这种不搞虚的节奏,在现在的市场里反而更有好感

我比较感兴趣的是它最近上的 Private TG 群,这操作挺反常规的 —— 不敞开招人,反而设了门槛。大家应该都有体会,现在很多项目群一打开全是水军喊单,除了情绪没半点有用的信息

Ferra 这个群就是要把这些噪音筛掉,只收真正为生态做贡献的人,比如有 Jacuzzi Badge 的、搞 Guild 的、链上交易活跃的大佬,还有 Kaito @KaitoAI上写优质内容的创作者。

进这个群的价值还是有的:能提前拿到产品更新信息、有专属福利,还能直接对接团队获得支持,不用在万人大群里费劲爬楼找信号,能通过审批进去,就说明你被项目方当成 “核心用户”了,后续有什么权益分配,大概率会更偏向这类人。

如果是在

SUI10.3%

- 赞赏

- 1

- 评论

- 转发

- 分享

2025 年快过完了,昨晚翻着钱包看这一年的交互记录,一边心疼 Gas 费,一边感叹:

咱们散户为了土狗那几十个点的涨幅,在链上P红了眼;结果转头一看,BlackRock(贝莱德)、Apollo 这些真正掌握万亿资金的金融巨头,居然已经悄悄在 Sei @SeiNetwork上“安家”了

这种感觉就像是,我们在抢地摊货,人家已经在隔壁把“地基”都买下来了

说实话,之前我对 Sei 的印象也停留在“高性能公链”的概念上

然后这两天躺床上Sei @SeiNetwork上,才又重新简单研究了一下这个链

看完后的感觉是:Sei 这一年虽然没有什么大动作,但至少做的事情都是脚踏实地的

1. 机构这次是玩真的:别觉得“机构合作”只是挂个 Logo

2025 年,Sei 上是真的落地了五家顶级机构的 RWA 基金(包括贝莱德、Brevan Howard 等)

背后还有 Securitize 和 Kaio@KAIO_xyz 做技术兜底,Ondo 的 USDY 也要来。

这意味着什么?意味着 Sei 的 RWA 生态已经过了“画饼”阶段,开始有真实的合规资产进场了

2. 不止是“快”,关键是“有人用” :

我们都知道Sei 主打的高性能(Giga 升级后 20 万+ TPS、400ms 确认)确实很秀,但我更看重的是真实数据:40 亿笔交易、8000 万个钱包地址。

甚至在去年 8 月,它的周活跃钱包

咱们散户为了土狗那几十个点的涨幅,在链上P红了眼;结果转头一看,BlackRock(贝莱德)、Apollo 这些真正掌握万亿资金的金融巨头,居然已经悄悄在 Sei @SeiNetwork上“安家”了

这种感觉就像是,我们在抢地摊货,人家已经在隔壁把“地基”都买下来了

说实话,之前我对 Sei 的印象也停留在“高性能公链”的概念上

然后这两天躺床上Sei @SeiNetwork上,才又重新简单研究了一下这个链

看完后的感觉是:Sei 这一年虽然没有什么大动作,但至少做的事情都是脚踏实地的

1. 机构这次是玩真的:别觉得“机构合作”只是挂个 Logo

2025 年,Sei 上是真的落地了五家顶级机构的 RWA 基金(包括贝莱德、Brevan Howard 等)

背后还有 Securitize 和 Kaio@KAIO_xyz 做技术兜底,Ondo 的 USDY 也要来。

这意味着什么?意味着 Sei 的 RWA 生态已经过了“画饼”阶段,开始有真实的合规资产进场了

2. 不止是“快”,关键是“有人用” :

我们都知道Sei 主打的高性能(Giga 升级后 20 万+ TPS、400ms 确认)确实很秀,但我更看重的是真实数据:40 亿笔交易、8000 万个钱包地址。

甚至在去年 8 月,它的周活跃钱包

- 赞赏

- 2

- 评论

- 转发

- 分享

大家圣诞节快乐!

一大早就收到了快递,今年又是吃上@BlockFocus11寄来的丹东大草莓了!也是连续吃上的第二年了!

这绝对是我吃过最好吃的草莓了,刚拿到家,已经吃了一半了🤣

感谢@BlockFocus11 @byreal_io 送来的精美草莓礼盒!

感谢我小洪哥@MetaEu7,巫师哥@Cryptowushi,二狗哥@CryptoErgou,以后每年都不愁草莓吃了!

希望大家都能在web3找到属于自己的财富,也让我们继续跟着BlockFocus keep building !

一大早就收到了快递,今年又是吃上@BlockFocus11寄来的丹东大草莓了!也是连续吃上的第二年了!

这绝对是我吃过最好吃的草莓了,刚拿到家,已经吃了一半了🤣

感谢@BlockFocus11 @byreal_io 送来的精美草莓礼盒!

感谢我小洪哥@MetaEu7,巫师哥@Cryptowushi,二狗哥@CryptoErgou,以后每年都不愁草莓吃了!

希望大家都能在web3找到属于自己的财富,也让我们继续跟着BlockFocus keep building !

- 赞赏

- 点赞

- 评论

- 转发

- 分享

好家伙,不是昨天看到JT哥@Jtsong2说0G @0G_labs还有空投我都不知道!这下圣诞节礼物又可以多加个猪脚饭了!

大家可以看看自己有没有在榜单上,然后记得绑定一下X和钱包,26号就结束了,以免错过奖励,我看挺多熟人的!

相信这个大毛之前大家都多多少少有撸到一些吧,现在银河又出了新的奖励,大家发文章的时候可以顺带带一手,当随手福利了!

Just joined @Galxe StarBoard!

StarBoard View , Collecting Aura for exclusive rewards – come claim yours!

#GalxeID gid:33RjVgzCWNW8M8QYDKTWAc @Galxe

大家可以看看自己有没有在榜单上,然后记得绑定一下X和钱包,26号就结束了,以免错过奖励,我看挺多熟人的!

相信这个大毛之前大家都多多少少有撸到一些吧,现在银河又出了新的奖励,大家发文章的时候可以顺带带一手,当随手福利了!

Just joined @Galxe StarBoard!

StarBoard View , Collecting Aura for exclusive rewards – come claim yours!

#GalxeID gid:33RjVgzCWNW8M8QYDKTWAc @Galxe

AURA4.59%

- 赞赏

- 点赞

- 评论

- 转发

- 分享

愉快的周末又结束啦,周一又得继续干活了,每次出去点这个菜都能干个两碗饭,感觉非常下饭!

不知道有没有和我一样的小伙伴,每次吃饭不吃点辣椒就感觉不自在🤣

记得之前,没菜吃都可以,有瓶老干妈就行了,都能多吃两碗!

对了,该说不说,Beldex @BeldexCoin整合的 BTCPay 如果能完善使用的话,感觉还是挺实用的

以前我是觉得隐私支付只能在链上,原来 Beldex 整合的 BTCPay 就是奔着线下消费匿名去的

比如在支持 BTCPay 的咖啡店付款,用 Beldex 钱包扫码就行,交易信息全程加密,商家和第三方都看不到你的真实身份和资产情况

不用再担心支付记录被追踪、被精准营销,这种 “线下隐身支付” 的体验,让隐私落地到了日常生活中,而不是只停留在链上,真正的实现隐私保护了!

#Beldex #线下隐私支付 #实用场景

不知道有没有和我一样的小伙伴,每次吃饭不吃点辣椒就感觉不自在🤣

记得之前,没菜吃都可以,有瓶老干妈就行了,都能多吃两碗!

对了,该说不说,Beldex @BeldexCoin整合的 BTCPay 如果能完善使用的话,感觉还是挺实用的

以前我是觉得隐私支付只能在链上,原来 Beldex 整合的 BTCPay 就是奔着线下消费匿名去的

比如在支持 BTCPay 的咖啡店付款,用 Beldex 钱包扫码就行,交易信息全程加密,商家和第三方都看不到你的真实身份和资产情况

不用再担心支付记录被追踪、被精准营销,这种 “线下隐身支付” 的体验,让隐私落地到了日常生活中,而不是只停留在链上,真正的实现隐私保护了!

#Beldex #线下隐私支付 #实用场景

BDX0.44%

- 赞赏

- 3

- 评论

- 转发

- 分享

热门话题

查看更多7207 热度

57.64万 热度

7.98万 热度

6876 热度

7773 热度

热门 Gate Fun

查看更多- 市值:$4167.35持有人数:22.29%

- 市值:$3686.2持有人数:10.00%

- 市值:$3746.31持有人数:20.09%

- 市值:$3687.46持有人数:20.23%

- 市值:$3641.37持有人数:10.00%

置顶

2025年报的关键词:增长

用户、份额、合规,全在推进亲爱的广场用户们,新年即将开启,我们希望您也能在 Gate 广场上留下专属印记,把 2026 的第一句话,留在 Gate 广场!发布您的 #我的2026第一帖,记录对 2026 的第一句期待、愿望或计划,与全球 Web3 用户共同迎接全新的旅程,创造专属于你的年度开篇篇章,解锁广场价值 $10,000 新年专属福利!

活动时间:2025/12/31 18:00 — 2026/01/15 23:59(UTC+8)

🎁 活动奖励:多发多奖,曝光拉满!

1️⃣ 2026 幸运大奖:从全部有效帖子中随机抽取 1 位,奖励包含:

2026U 仓位体验券

Gate 新年限定礼盒

全年广场首页推荐位曝光

2️⃣ 人气新年帖 TOP 1–10:根据发帖量及互动表现综合排名,奖励包含:

Gate 新年限定礼盒

广场精选帖 5 篇推荐曝光

3️⃣ 新手首帖加成奖励:活动前未在广场发帖的用户,活动期间首次发帖即可获得:

50U 仓位体验券

进入「新年新声」推荐榜单,额外曝光加持

4️⃣ 基础参与奖励:所有符合规则的用户中随机抽取 20 位,赠送新年 F1 红牛周边礼包

参与方式:

1️⃣ 带话题 #我的2026第一条帖 发帖,内容字数需要不少于 30 字

2️⃣ 内容方向不限,可以是以下内容:

写给 2026 的第一句话

新年目标与计划

Web3 领域探索及成长愿景

注意事项

• 禁止抄袭、洗稿及违规Gate 2025 年终盛典投票开启

支持你喜爱的主播和内容达人,一起冲榜年度荣誉 🚀

投票即可参与抽奖,iPhone 17 Pro Max、Gate 周边等你拿

助力值排名 TOP 20 还有额外实物奖励:京东 E 卡、Gate × Red Bull 双肩包、周边盲盒等

立即助力:https://www.gate.com/activities/community-vote-2025

了解详情:https://www.gate.com/announcements/article/48693